Google ปฏิวัติ AI! เปิดตัว “TurboQuant” ลดการใช้แรม LLM ได้ 6 เท่า เร็วขึ้นโดยไม่เสียความแม่นยำ

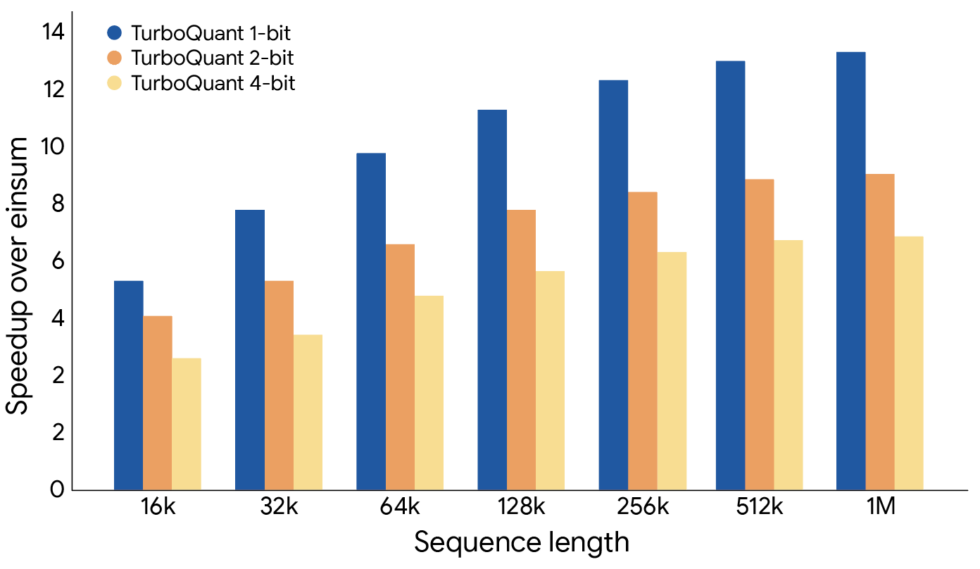

Google เปิดตัวเทคโนโลยีใหม่ชื่อ TurboQuant ที่อาจกลายเป็น “จุดเปลี่ยนสำคัญ” ของวงการ AI หลังสามารถลดการใช้หน่วยความจำของโมเดลขนาดใหญ่ (LLM) ได้มากถึง 6 เท่า โดยยังคงความแม่นยำไว้ได้เหมือนเดิม

ความเคลื่อนไหวนี้เกิดขึ้นท่ามกลางปัญหาใหญ่ของอุตสาหกรรม AI ที่กำลังเผชิญ “คอขวดด้านหน่วยความจำ” ซึ่งเป็นต้นทุนหลักของการพัฒนาและใช้งานโมเดลขนาดใหญ่ในปัจจุบัน

ลดแรม 6 เท่า แต่ยัง “แม่นเหมือนเดิม”

หัวใจของปัญหาใน LLM อยู่ที่สิ่งที่เรียกว่า “key-value cache” ซึ่งเป็นพื้นที่เก็บข้อมูลบริบทของบทสนทนา ยิ่งคุยนาน ระบบยิ่งต้องใช้หน่วยความจำมากขึ้นแบบทวีคูณ

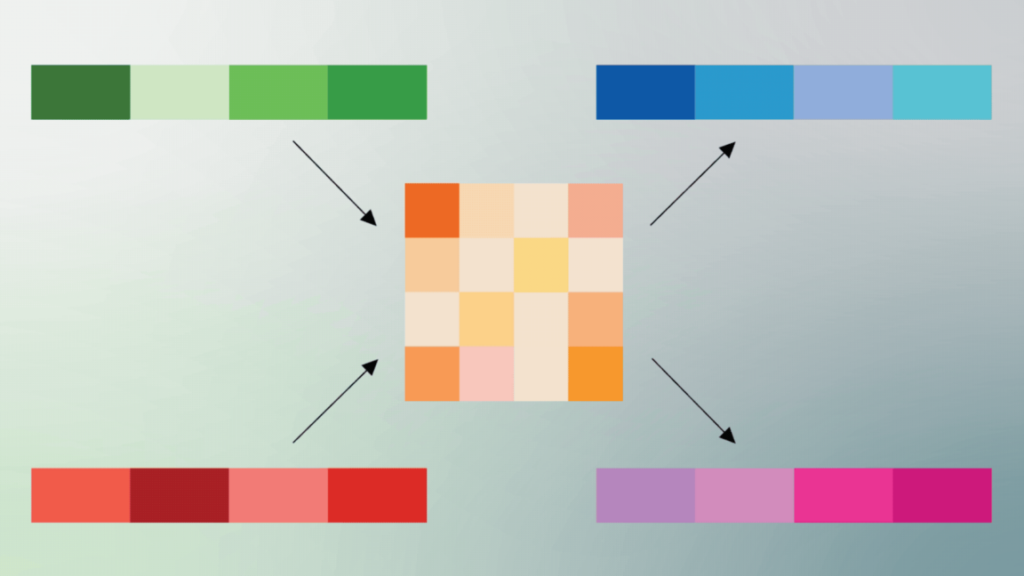

TurboQuant เข้ามาแก้ปัญหานี้โดยใช้เทคนิคการบีบอัดข้อมูล (vector quantization) ที่ทำให้สามารถลดขนาดหน่วยความจำลงได้อย่างมาก โดย Google ระบุว่าสามารถลดได้ถึง 6 เท่าโดยไม่กระทบคุณภาพของผลลัพธ์

นอกจากนี้ ยังช่วยเพิ่มประสิทธิภาพการประมวลผลได้สูงสุดถึง 8 เท่าในบางกรณี ทำให้ AI ตอบสนองได้เร็วขึ้น และใช้ทรัพยากรน้อยลง

เบื้องหลังเทคโนโลยีนี้คือการผสาน 3 อัลกอริทึม ได้แก่ TurboQuant, PolarQuant และ Quantized Johnson-Lindenstrauss ซึ่งช่วยลดข้อมูลโดยไม่ทำให้ความแม่นยำเพี้ยนเหมือนวิธีแบบเดิม

AI ถูกลง เร็วขึ้น และอาจลงอุปกรณ์ทั่วไปได้

สิ่งที่ทำให้ TurboQuant น่าสนใจไม่ใช่แค่ตัวเลข แต่คือ “ผลกระทบเชิงระบบ” ต่อทั้งอุตสาหกรรม

เมื่อใช้หน่วยความจำน้อยลง หมายความว่าองค์กรสามารถรัน AI ได้บนฮาร์ดแวร์เดิม หรือใช้ต้นทุนน้อยลงในการขยายระบบ ซึ่งช่วยลดแรงกดดันด้านค่าใช้จ่ายของ Data Center ได้อย่างมีนัยสำคัญ

ยิ่งไปกว่านั้น เทคโนโลยีนี้อาจเปิดทางให้ AI ขั้นสูงสามารถทำงานบนอุปกรณ์ทั่วไปอย่างโน้ตบุ๊กหรือสมาร์ทโฟนได้ดีขึ้น เพราะสามารถเก็บบริบทได้มากขึ้นโดยไม่กินแรมมหาศาล

อีกมุมหนึ่ง มันยังอาจส่งผลต่อทั้งอุตสาหกรรมฮาร์ดแวร์ โดยเฉพาะตลาดหน่วยความจำ ที่เคยได้อานิสงส์จากความต้องการ AI อย่างมหาศาล