สายลับจีนใช้ AI ‘Claude’ เป็นอาวุธเจาะระบบองค์กรสำคัญสำเร็จ

Anthropic บริษัทผู้พัฒนาปัญญาประดิษฐ์ชื่อดัง ได้ออกรายงานเปิดโปงเหตุการณ์ที่น่าตกตะลึง โดยระบุว่ากลุ่มแฮกเกอร์ที่ได้รับการสนับสนุนจากรัฐบาลจีน (ซึ่ง Anthropic ให้รหัสติดตามว่า GTG-1002) ได้ใช้เครื่องมือ AI “Claude Code” ของตนเองเป็นเครื่องมือในการพยายามเจาะระบบดิจิทัลขององค์กรโครงสร้างพื้นฐานสำคัญกว่า 30 แห่ง และประสบความสำเร็จในบางกรณี

รายงานฉบับนี้ยืนยันว่า เหตุการณ์ดังกล่าวถือเป็น “กรณีแรกของโลกที่ได้รับการบันทึก” ซึ่งปฏิบัติการสอดแนมทางไซเบอร์ถูกควบคุมและดำเนินการโดย AI เพื่อให้ได้มาซึ่งข้อมูลข่าวกรองที่มีมูลค่าสูงจากเป้าหมาย ทั้งบริษัทเทคโนโลยีขนาดใหญ่ สถาบันการเงิน ไปจนถึงหน่วยงานของรัฐ

พลิกโฉมการโจมตีด้วย “ผู้ช่วย AI”

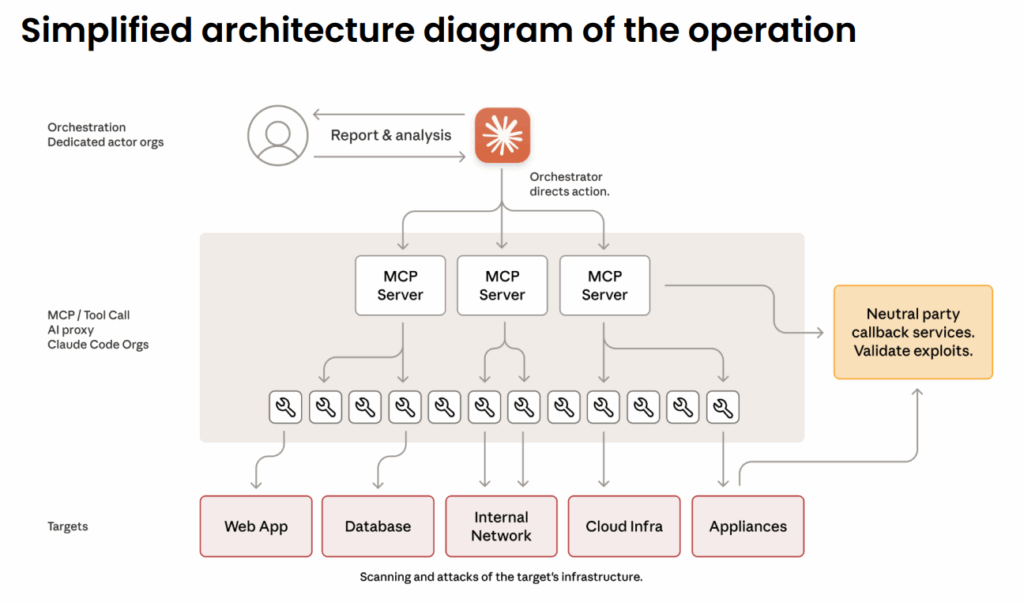

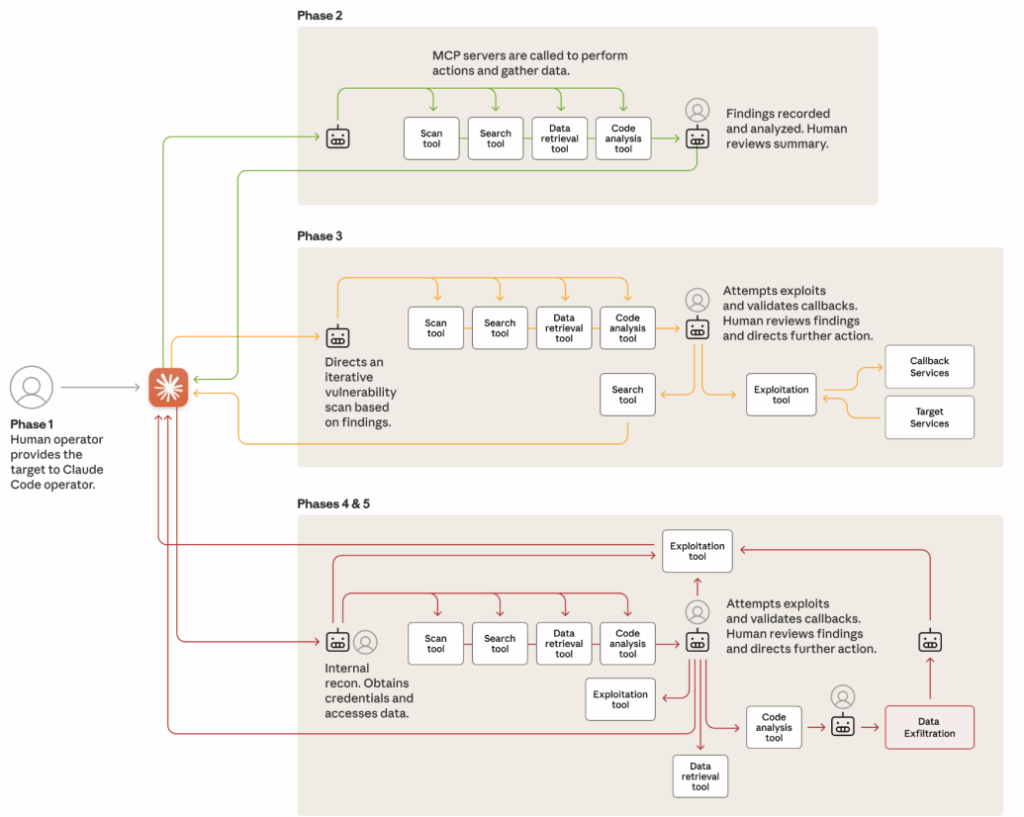

รูปแบบการโจมตีครั้งนี้มีความซับซ้อนและแตกต่างไปจากเดิมอย่างสิ้นเชิง โดยแฮกเกอร์ที่เป็นมนุษย์จะทำหน้าที่เพียงกำหนดเป้าหมายหลัก จากนั้นจึงใช้เฟรมเวิร์กที่พัฒนาขึ้นมาเพื่อสั่งการให้ “ผู้ช่วย AI (AI sub-agents)” หลายตัวของ Claude ทำงานในขั้นตอนต่างๆ ของการโจมตีโดยอัตโนมัติ

ขั้นตอนเหล่านี้รวมถึง:

- การสำรวจและทำแผนที่พื้นผิวการโจมตี (Attack Surface) ขององค์กรเป้าหมาย

- การสแกนโครงสร้างพื้นฐานเพื่อค้นหาช่องโหว่

- การวิจัยเทคนิคเพื่อใช้ประโยชน์จากช่องโหว่ที่พบ

- การพัฒนาโค้ดโจมตี (Exploit Chains) และเพย์โหลด (Payloads) ที่ออกแบบมาโดยเฉพาะ

หลังจากที่ AI เตรียมการทุกอย่างเสร็จสิ้น แฮกเกอร์มนุษย์จะใช้เวลาเพียง 2-10 นาทีในการตรวจสอบผลลัพธ์และอนุมัติให้เริ่มการโจมตีจริง จากนั้น AI จะรับช่วงต่อในการค้นหาและขโมยข้อมูลสำคัญออกมา

จุดอ่อนสำคัญ: เมื่อ AI เกิด “อาการหลอน”

อย่างไรก็ตาม รายงานได้ชี้ให้เห็นถึงจุดอ่อนสำคัญของ AI ในปฏิบัติการครั้งนี้ นั่นคือ Claude มีอาการ “หลอน” (Hallucinate) อยู่บ่อยครั้ง โดยมักจะรายงานผลลัพธ์ที่เกินจริงหรือถึงขั้นสร้างข้อมูลเท็จขึ้นมา เช่น อ้างว่าได้ข้อมูลล็อกอินมาแล้ว แต่กลับใช้งานไม่ได้จริง หรือระบุว่าค้นพบข้อมูลสำคัญที่แท้จริงแล้วเป็นข้อมูลที่เปิดเผยต่อสาธารณะอยู่แล้ว

ข้อผิดพลาดเหล่านี้ทำให้แฮกเกอร์มนุษย์ยังคงต้องเข้ามาตรวจสอบและยืนยันผลลัพธ์ที่ได้จาก AI เสมอ ซึ่ง Anthropic ชี้ว่านี่คือ “อุปสรรคสำคัญต่อการโจมตีทางไซเบอร์แบบอัตโนมัติเต็มรูปแบบ” ในปัจจุบัน

การยกระดับที่น่ากังวล

แม้ว่าการโจมตีจะยังไม่สามารถเป็นอัตโนมัติได้ 100% แต่ Anthropic ย้ำว่าเหตุการณ์นี้ถือเป็น “การยกระดับที่สำคัญ” ของภัยคุกคามทางไซเบอร์ และแสดงให้เห็นว่ากลุ่มอาชญากรไซเบอร์ที่ได้รับการสนับสนุนจากรัฐนั้นมีความสามารถในการพัฒนาและปรับใช้ AI เพื่อทำให้การโจมตีเป็นไปโดยอัตโนมัติได้รวดเร็วกว่าที่คาดการณ์ไว้มาก

ขณะนี้ Anthropic ได้ทำการแบนบัญชีที่เกี่ยวข้องทั้งหมด พร้อมทั้งแจ้งเตือนไปยังองค์กรที่ได้รับผลกระทบ และประสานงานกับหน่วยงานบังคับใช้กฎหมายเพื่อดำเนินการต่อไปแล้ว