“ความน่าเชื่อถือ” และ “ความปลอดภัย” สองปัจจัยสำคัญกำหนดอนาคต Generative AI

ความก้าวหน้าอย่างรวดเร็วแบบหายใจรดต้นคอของนวัตกรรมปัญญาประดิษฐ์เอไอแบบรู้สร้าง หรือ Generative AI ทำให้เกิดความวิตกด้านความปลอดภัยและความเสี่ยงเพิ่มมากขึ้นตามมา มีนักกฎหมายบางรายเสนอกฎระเบียบและข้อบังคับใหม่เพื่อกำกับดูแลเครื่องมือปัญญาประดิษฐ์ต่าง ๆ และยังมีผู้นำธุรกิจและเทคโนโลยีบางคนออกมาแนะนำให้ระงับการฝึกระบบเอไอเป็นการชั่วคราวเพื่อเป็นการประเมินด้านความปลอดภัยของตน

Generative AI อยู่รอบตัวเรา

ความเป็นจริงที่ว่าการพัฒนา Generative AI ไม่หยุดอยู่เท่านี้ องค์กรจำเป็นต้องดำเนินการตั้งแต่ตอนนี้เพื่อกำหนดกลยุทธ์ภาพรวมสำหรับจัดการด้านความน่าเชื่อถือ ความเสี่ยง และการรักษาความปลอดภัยของเทคโนโลยีปัญญาประดิษฐ์ (หรือ AI TRiSM) ซึ่งมีความจำเป็นเร่งด่วนเพื่อเรียนรู้และเข้าใจเครื่องมือ AI TRiSM สำหรับใช้จัดการข้อมูลและกระบวนการระหว่างผู้ใช้และบริษัทที่เป็นเจ้าของโมเดลพื้นฐานของ Generative AI

เวลานี้ยังไม่มีเครื่องมือสำเร็จรูปใดในตลาดที่รับรองความเป็นส่วนตัวแก่ผู้ใช้อย่างเป็นระบบหรือสามารถกรองเนื้อหาได้อย่างมีประสิทธิภาพเมื่อนำโมเดลเหล่านี้มาใช้งาน ตัวอย่างเช่น การกรองข้อมูลที่ไม่ถูกต้องออกจากข้อเท็จจริง รูปภาพที่ไม่มีอยู่จริง เนื้อหาที่มีลิขสิทธิ์หรือข้อมูลที่เป็นความลับ

นักพัฒนา AI ต้องทำงานร่วมกับผู้กำหนดนโยบายเป็นกรณีเร่งด่วน รวมถึงหน่วยงานกำกับดูแลที่เกิดขึ้นมาใหม่ เพื่อกำหนดนโยบายและวางแนวทางปฏิบัติสำหรับการกำกับดูแลและการจัดการความเสี่ยงของเอไอ

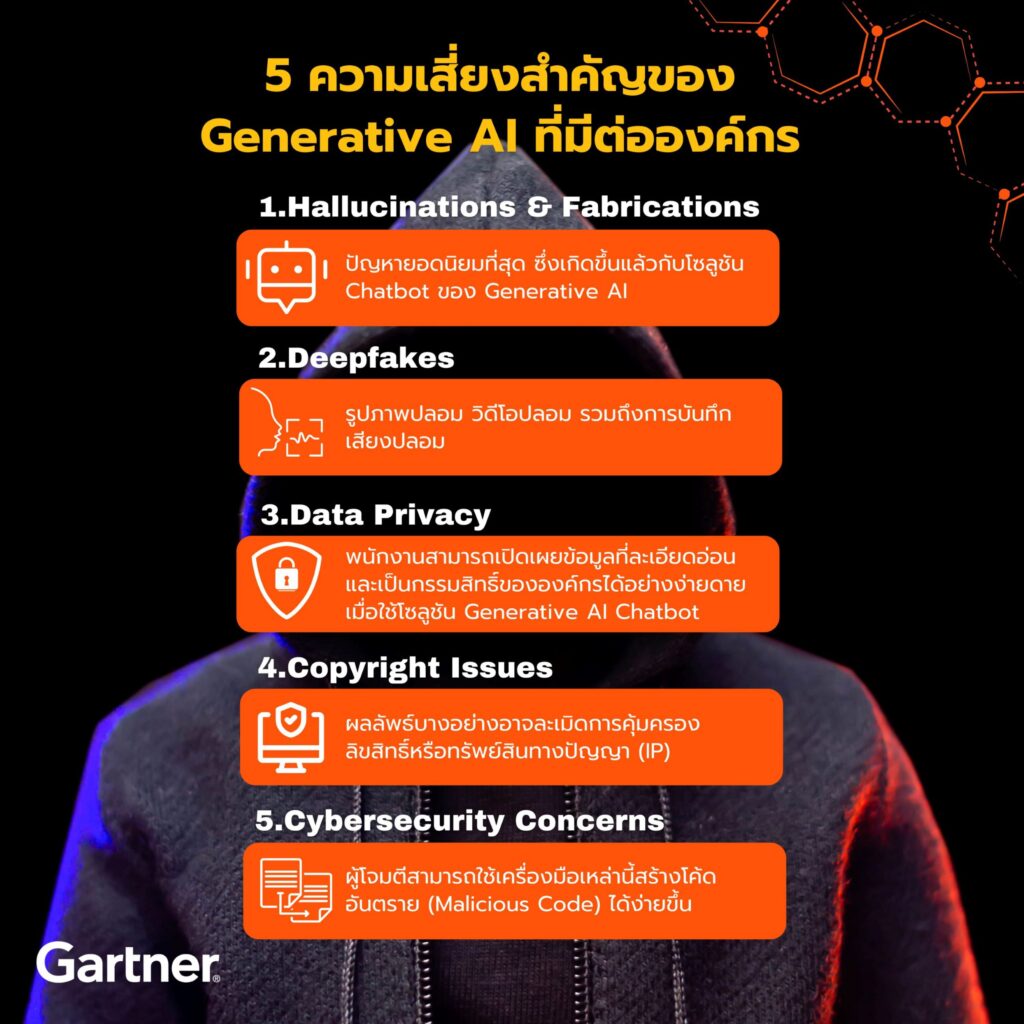

ความเสี่ยงสำคัญที่กระทบองค์กร

Generative AI ก่อให้เกิดความเสี่ยงใหม่ ๆ หลายประการ ประการแรกคือ “ล่อลวงด้วยภาพลวงตา (Hallucinations)” และการปลอมแปลง อาทิ ข้อมูลที่ผิดแปลกไปจากข้อเท็จจริง ซึ่งเป็นปัญหายอดนิยมที่สุดซึ่งเกิดขึ้นแล้วกับโซลูชัน Chatbot ของ Generative AI กรณีข้อมูลการฝึกอบรม กรณีการตอบสนองที่มีอคติ ไม่อยู่ในหลักสมมุติฐานหรือมีความไม่ถูกต้อง กรณีเหล่านี้ตรวจจับได้ยากโดยเฉพาะอย่างยิ่งเมื่อโซลูชันนั้นมีความน่าเชื่อถือและมีผู้ใช้จำนวนมากขึ้นเรื่อย ๆ

ความเสี่ยงต่อมา คือ Deepfakes เมื่อ Generative AI ถูกนำไปใช้สร้างเนื้อหาที่มีเจตนามุ่งร้าย ซึ่งล้วนเป็นความเสี่ยงสำคัญ เช่น รูปภาพปลอม วิดีโอปลอม รวมถึงการบันทึกเสียงปลอม ที่มักถูกใช้เพื่อโจมตีเหล่าคนดังและนักการเมือง เพื่อนำไปสร้างและเผยแพร่ข้อมูลที่ก่อให้เกิดความเข้าใจผิด หรือแม้กระทั่งใช้สร้างบัญชีปลอมหรือเข้าไปยึดและเจาะบัญชีที่ถูกต้องตามกฎหมายที่มีอยู่เดิม

ตัวอย่างเมื่อเร็ว ๆ นี้ คือ กรณีภาพพระสันตปาปาฟรานซิสที่สวมแจ็กเก็ตแฟชั่นสีขาวที่สร้างขึ้นโดย AI และกลายเป็นไวรัลบนโซเชียลมีเดีย แม้จะดูเหมือนไม่มีพิษภัย แต่ก็ทำให้เรามองเห็นอนาคตของ Deepfakes ในการปลอมแปลงคนมีชื่อเสียง ลอกเลียนแบบ ล่อลวง และความเสี่ยงทางการเมืองต่อทั้งตัวบุคคล องค์กร และภาครัฐบาล

ความเป็นส่วนตัวของข้อมูล (Data privacy) ก็น่ากังวลใจไม่ใช่น้อยโดยเฉพาะเมื่อองค์กรให้สิทธิ์พนักงานสามารถเปิดเผยข้อมูลที่ละเอียดอ่อนและเป็นกรรมสิทธิ์ขององค์กรได้อย่างง่ายดายเมื่อใช้โซลูชัน Generative AI Chatbot โดยแอปพลิเคชันเหล่านี้อาจจัดเก็บข้อมูลที่ผู้ใช้ป้อนเข้ามา หรือแม้แต่ข้อมูลที่ใช้ป้อนเพื่อฝึกอบรมโมเดลเอไออื่น ๆ โดยข้อมูลดังกล่าวอาจตกไปอยู่ในมือของผู้ไม่หวังดีกรณีที่เกิดการละเมิดความปลอดภัย

ต่อมาคือ ปัญหาด้านลิขสิทธิ์ (Copyright Issues) แชทบอท Generative AI ได้รับการฝึกอบรมด้านข้อมูลอินเทอร์เน็ตจำนวนมาก ซึ่งอาจรวมถึงเนื้อหาที่มีลิขสิทธิ์ โดยอาจมีผลลัพธ์บางอย่างละเมิดการคุ้มครองลิขสิทธิ์หรือทรัพย์สินทางปัญญา (IP) หากไม่มีการอ้างอิงแหล่งที่มาหรือมีความโปร่งใสเกี่ยวกับวิธีสร้างผลลัพธ์ ดังนั้นวิธีเดียวที่จะลดความเสี่ยงนี้คือให้ผู้ใช้ตรวจสอบข้อเท็จจริงเพื่อให้แน่ใจว่าไม่ได้ละเมิดลิขสิทธิ์หรือสิทธิ์ในทรัพย์สินทางปัญญา

สุดท้าย คือ ข้อกังวลด้านความปลอดภัยทางไซเบอร์ (Cybersecurity Concerns) นอกเหนือจากการล่อลวงทางวิศวกรรมทางสังคมขั้นสูงและภัยคุกคามแบบฟิชชิงแล้ว ผู้โจมตีสามารถใช้เครื่องมือเหล่านี้สร้างโค้ดอันตราย (Malicious Code) ได้ง่ายขึ้น

ผู้ขายที่นำเสนอโมเดลพื้นฐาน Generative AI ต้องให้ความมั่นใจกับลูกค้าว่าได้มีการฝึกฝนและทดสอบโมเดลดังกล่าวนี้เพื่อปฏิเสธคำขอด้านความปลอดภัยทางไซเบอร์ที่เป็นอันตราย อย่างไรก็ตามผู้ขายจะไม่ได้ให้เครื่องมือตรวจสอบการควบคุมความปลอดภัยที่มีประสิทธิภาพทั้งหมดแก่องค์กร โดยพวกเขายังให้ความสำคัญกับแนวทางป้องกันแบบ “ทีมผู้บุกรุกสีแดง หรือ Red Teaming ที่เป็นแนวทางการทดสอบระบบโดยแสร้งเป็นผู้บุกรุกทางดิจิทัลหรือทางกายภาพ“ เป็นอย่างมาก ซึ่งการใช้แนวทางนี้คือต้องการให้องค์กรมั่นใจเต็มที่กับความสามารถต่าง ๆ ที่ผู้ขายนำเสนอสำหรับจัดการตามเป้าหมายด้านความปลอดภัย

รับมือและจัดการความเสี่ยงจาก AI

มีแนวทางทั่วไปที่เราสามารถดึงศักยภาพของ ChatGPT และแอปพลิเคชันที่คล้ายกันมาใช้อยู่สองแบบ ได้แก่ Out-Of-The-Box Model ที่ใช้ประโยชน์จากบริการที่มีอยู่เดิม โดยไม่ปรับแต่งค่าใด ๆ เพิ่มเติม และแนวทางที่สองคือ Prompt Engineering ที่ใช้เครื่องมือสร้าง ปรับแต่ง และประเมินข้อมูลอินพุตและเอาต์พุต

สำหรับการใช้ Out-Of-The-Box Model องค์กรต้องตรวจสอบข้อมูลเอาต์พุตของโมเดลทั้งหมดด้วยตนเอง เพื่อตรวจหาผลลัพธ์ที่ไม่ถูกต้อง ข้อมูลที่ผิดหรือคลาดเคลื่อนไม่เป็นกลาง โดยกำหนดกรอบการกำกับดูแลและการปฏิบัติตามหลักธรรมาภิบาลเพื่อเปิดใช้โซลูชันจำพวกนี้ในองค์กร พร้อมวางนโยบายที่ชัดเจน ห้ามพนักงานถามคำถามที่เปิดเผยข้อมูลองค์กรหรือข้อมูลส่วนบุคคลที่ละเอียดอ่อน

องค์กรควรตรวจสอบการใช้งาน ChatGPT และโซลูชันที่คล้ายคลึงกันที่ไม่ได้รับอนุญาตด้วยการควบคุมความปลอดภัยและแดชบอร์ดที่มีอยู่สำหรับตรวจจับการละเมิดนโยบายการใช้งาน เช่น ไฟร์วอลล์ที่สามารถบล็อกการเข้าถึงของผู้ใช้ในองค์กร ข้อมูลความปลอดภัยและระบบการจัดการเหตุการณ์ที่สามารถตรวจสอบบันทึกการละเมิด และเว็บเกตเวย์ที่มีความปลอดภัยที่สามารถปิดกั้นการเรียกใช้ API ที่ไม่ได้รับอนุญาตได้

สำหรับการใช้ Prompt Engineering มีมาตรการลดความเสี่ยงทั้งหมดพร้อมใช้อยู่แล้ว ซึ่งองค์กรควรดำเนินการตามขั้นตอนเพื่อปกป้องข้อมูลภายในและข้อมูลสำคัญอื่น ๆ ที่ใช้สื่อสารกับเอไอในโครงสร้างพื้นฐานของบุคคลที่สาม โดยการสร้างและจัดเก็บข้อความการสื่อสารทางวิศวกรรมกับเอไอให้เป็นสินทรัพย์ถาวร

และสินทรัพย์เหล่านี้ยังสามารถแสดงการสื่อสารกับเอไออย่างมีนัยสำคัญและผ่านการตรวจสอบแล้วว่าสามารถนำมาใช้ได้อย่างปลอดภัย นอกจากนี้ยังใช้เป็นคลังข้อมูลการสื่อสารกับเอไอที่ได้รับการปรับแต่งและพัฒนาขั้นสูงที่สามารถนำมาใช้ซ้ำ แชร์ หรือจำหน่ายต่อได้

บทความโดย เอวิวา ลิทาน รองประธานฝ่ายวิจัย การ์ทเนอร์